08. Juli 2021 | Bericht

EU AI-Act: Die Europäische Kommission will einheitliche Vorgaben für KI in der ganzen EU etablieren.

Im April 2021 hat die Behörde dafür ihren Vorschlag für eine harmonisierte Regulierung von künstlicher Intelligenz (KI) in der Europäischen Union veröffentlicht. Der Vorschlag baut auf dem „White Paper on Artifical Intelligence – a European approach to excellence and trust” vom Februar 2020 auf. Der VCI hatte sich seinerzeit an der öffentlichen Konsultation beteiligt.

Die aktuellen Vorschläge sind erwartungsgemäß umfangreich. Allein das Hauptdokument zählt 120 Seiten. Die EU-Kommission hat große Ziele. Sie möchte einerseits „Innovationen nicht im Wege stehen“. Gleichzeitig müsse der Gesetzgeber aber eingreifen, wenn „Sicherheit und Grundrechte der EU-Bürger auf dem Spiel stehen“.

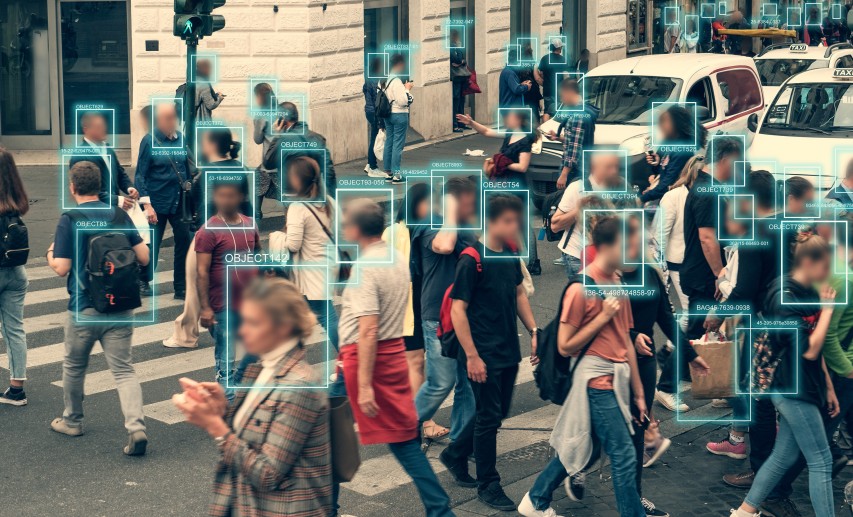

Als prominente Beispiele nennt der Vorschlag Gesichtserkennung oder das autonome Fahren. Für die „große Mehrheit von KI-Systemen“ sollen aber keine besonderen Anforderungen gelten, die über die üblichen Regeln zur Produktsicherheit hinausgehen.

Vier KI-Stufen mit unterschiedlichen Vorgaben

Der Kommissionsvorschlag folgt einem vierstufigen, risikobasierten Ansatz. In der niedrigsten Kategorie finden sich Anwendungen wie Spam-Filter, die aus Sicht der Behörde bereits von existierender Regulierung erfasst werden.

Für die nächsthöheren Kategorie ergeben sich leicht höhere Anforderungen. Beispielsweise müssten sich Chatbots künftig als solche identifizieren.

Hauptfokus der Regulierung sollen die sogenannten Hochrisiko-Anwendungen sein. Hierrunter versteht die Kommission KI-Systeme, die „ein hohes Risiko für die Gesundheit und Sicherheit oder für die Grundrechte natürlicher Personen darstellen“. Hierbei werden Anwendungen im privaten Sektor und Anwendungen der Sicherheitsbehörden auf die gleiche Stufe gestellt.

In der vierten Stufe beschreibt die EU-Kommission KI-Technologien, die als unannehmbar gelten, weil sie die Werte der Europäischen Union, beispielsweise Grundrechte, verletzen. Verboten werden sollen daher etwa KI-Systeme, die soziales Verhalten bewerten (Stichwort: Social Scoring).

Was ist für die Industrie geplant?

Aus Sicht der Industrie und unserer Branche gibt es eine Reihe von Punkten in dem Kommissionsvorschlag, die näher betrachtet werden müssen.

Zunächst ist die allgemeine Definition von KI sehr breit gefasst (siehe hierzu Annex I). Neben dem sogenannten Machine- und Deep Learning werden ebenfalls Ansätze unter KI einsortiert, die man eher im Bereich der klassischen IT verorten würde („Logik- und wissensgestützte Ansätze“). Auch sollen statistische Ansätze nach Lesart der EU-Kommission unter die künstliche Intelligenz fallen. Würde man diese Definition streng auslegen, könnte künftig jegliche IT-Technologie KI sein.

Kritischer hingegen ist jedoch die breite und teils offene Definition sogenannter Hochrisiko-Anwendungen. Künftig sollen Sicherheitskomponenten, die in Produkten verwendet werden, zu dieser Kategorie zählen. Das würde auch Sicherheitssysteme erfassen, die in explosionsgefährdeten Bereichen eingesetzt werden und einer externer Konformitätsbewertung durch Dritte unterliegen. Es ist davon auszugehen, dass diese Definition auf viele (KI-)Systeme zutrifft, die in der chemisch-pharmazeutischen Industrie eingesetzt werden.

Außerdem sollen für Hochrisiko-Anwendungen weitreichende Anforderungen gelten. Umfassende Dokumentationspflichten sind ebenso vorgesehen, wie der uneingeschränkte Zugang für eine „Marktüberwachungsbehörde“ zu den KI-Trainingsdaten. Sie sollen automatisiert über eine Schnittstelle zur Verfügung gestellt werden.

Aus Sicht der EU-Kommission ist auch die menschliche Überwachung von Hochrisiko-Anwendungen erforderlich. Fragen zum Schutz geistigen Eigentums bleiben bislang noch unbeantwortet. Es ist davon auszugehen, dass diese Maßnahmen dem Ziel „Innovation nicht im Wege stehen zu wollen“ diametral entgegenlaufen.

KI-Verordnung immer aktuell halten

Neben solchen inhaltlichen Kritikpunkten wäre es nötig, die Verordnung nach ihrem Inkrafttreten regelmäßig zu evaluieren. Bislang plant die EU-Kommission die erste Überprüfung nach drei Jahren ein. Dieser Zeitraum ist aber angesichts der rasch voranschreitenden technologischen Entwicklung viel zu lang. Damit könnte die EU international den Anschluss verlieren.

Über die Vorschläge der Kommission müssen nun noch die EU-Staaten und das Europaparlament verhandeln. Es dürfte also noch etwas Zeit ins Land gehen, ehe die neuen Regeln in Kraft treten. Der VCI aktualisiert derzeit sein KI-Positionspapier und wird sich intensiv in die politische Diskussion einbringen. Hierbei arbeiten wir mit Partnern wie dem Bundesverband der Deutschen Industrie (BDI) zusammen.

Kontakt

Für Fragen und Anregungen nehmen Sie gerne Kontakt mit uns auf.

Dipl.-Volksw. Christian Bünger

Digitalpolitik, Digitalisierung, Informatikausschuss

- E-Mail: christian.buenger@vci.de